Anni '60: l'open office inizia a prendere piede come design popolare

L'ufficio si è trasformato radicalmente negli ultimi decenni: nel layout, nello stile, nei colori, nella cultura del lavoro e nella tecnologia. Questi decenni hanno visto il lavoratore diventare più individualista, con il design dell'ufficio diventato più ergonomico e più high tech.

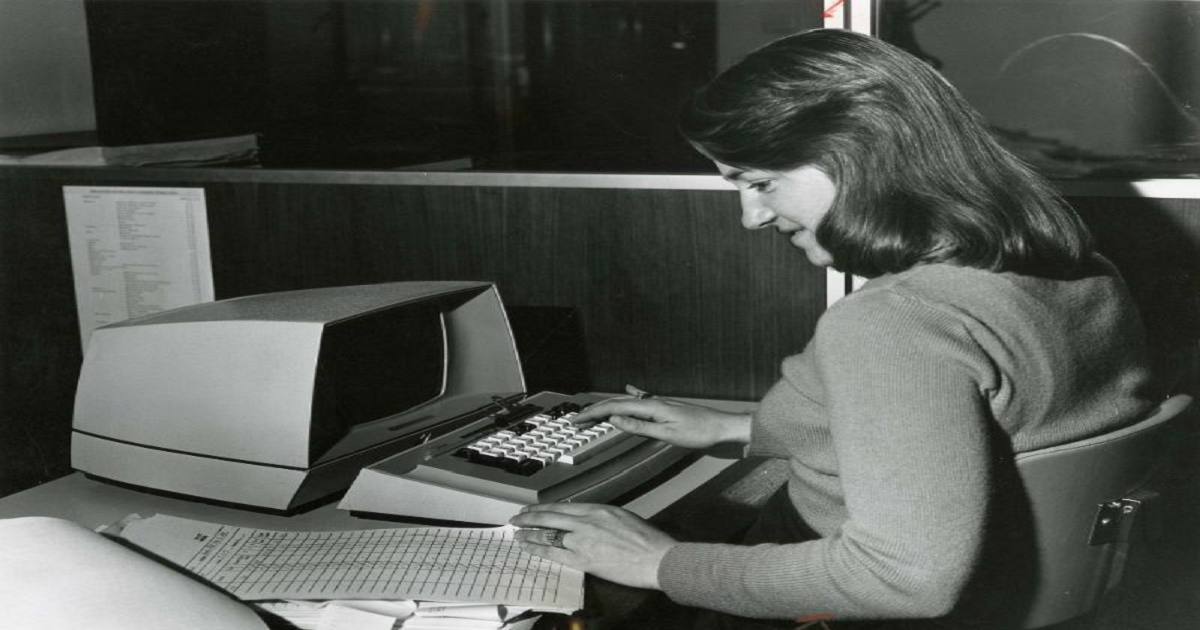

Fu solo negli anni '60 che l'open office iniziò davvero a prendere piede come design popolare per i luoghi di lavoro. Bürolandschaft, originariamente un approccio progettuale tedesco che si traduce in "paesaggio dell'ufficio", mirava a democratizzare il posto di lavoro e creare una maggiore interazione tra i colleghi.

In risposta alla crescente popolarità del vasto spazio ufficio aperto, Robert Propst, presidente di Herman Miller Research Corp., ha scritto: “L'ufficio di oggi è una terra desolata. Indebolisce la vitalità, blocca il talento, frustra la realizzazione. È la scena quotidiana di intenzioni non realizzate e sforzi falliti.

Nel 1964 l'azienda di mobili Herman Miller ha introdotto l'Action Office, una combinazione flessibile di scrivanie, tavoli e pareti. Era colorato ed elegante, inteso a liberare i lavoratori migliorando la loro libertà di movimento e privacy.

Ma la necessità di spazi per uffici stava crescendo rapidamente alla fine degli anni '60 e '70. Le aziende richiedevano mobili più economici, più adattabili e che richiedessero meno spazio.

Herman Miller ha ridisegnato l'Action Office per renderlo più piccolo e leggero e altre aziende di mobili hanno introdotto versioni imitazioni. Il cubicolo è nato.

L'Action Office II mirava a garantire ai dipendenti una maggiore privacy. I cubicoli alla fine divennero un'industria da miliardi di dollari; molte aziende li hanno usati come un modo per inserire più persone in piccoli uffici.

Robert Propst, l'inventore dell'Action Office, ha passato i suoi ultimi anni a scusarsi per la sua creazione. “Non tutte le organizzazioni sono intelligenti e progressiste”, disse nel 1998, due anni prima di morire. “Molti sono gestiti da persone grossolane. Fanno piccoli cubicoli e ci riempiono le persone. Posti aridi, topaie.

Mentre potrebbe essere comune lanciarsi al lavoro indossando quello che ti piace con solo un cordino per mostrare che sei uno staff, negli anni '70 non era niente del genere. Proprio come ogni cubicolo aveva uno stile di base, ogni dipendente si presentava indossando le insegne complete.

Negli anni '80 i cubicoli avevano preso il sopravvento e si trovavano nella maggior parte degli edifici per uffici. La tecnologia stava avanzando rapidamente e sempre più lavoratori ora avevano un computer.

Sfortunatamente, i computer degli anni '80 erano assolutamente enormi, quindi le scrivanie sono diventate più pesanti durante questo periodo per far fronte al peso e alle dimensioni. Il design degli uffici degli anni '80 era ampiamente definito dalla parola "funzionalità".

Tuttavia, verso la fine del decennio, iniziò a diventare un po' più sperimentale. Durante questo periodo sono stati introdotti molto vetro, cemento e linee pulite.

Il concetto di telelavoro è stato proposto nei primi anni '70 da Jack Nilles, un ex ingegnere della NASA. Lo offrì come alternativa al trasporto che drenava risorse durante la crisi petrolifera di quell'epoca.

La sua visione comprendeva uffici satellite che consentissero ai dipendenti di un'azienda di lavorare più vicino a dove vivevano, contribuendo a ridurre la congestione del traffico nelle aree urbane.

Negli anni '80 e '90, la tecnologia è migliorata ei suoi costi sono diminuiti, rendendo il telelavoro praticabile per più posti di lavoro. Aziende come IBM e JC Penney, e persino agenzie federali statunitensi, hanno iniziato a sperimentare programmi di lavoro a distanza per ridurre le spese di ufficio e offrire ai dipendenti maggiore flessibilità.

© 𝗯𝘆 𝗔𝗻𝘁𝗼𝗻𝗲𝗹𝗹𝗼 𝗖𝗮𝗺𝗶𝗹𝗼𝘁𝘁𝗼

Tutti i diritti riservati | All rights reserved

Informazioni Legali

I testi, le informazioni e gli altri dati pubblicati in questo sito nonché i link ad altri siti presenti sul web hanno esclusivamente scopo informativo e non assumono alcun carattere di ufficialità.

Non si assume alcuna responsabilità per eventuali errori od omissioni di qualsiasi tipo e per qualunque tipo di danno diretto, indiretto o accidentale derivante dalla lettura o dall'impiego delle informazioni pubblicate, o di qualsiasi forma di contenuto presente nel sito o per l'accesso o l'uso del materiale contenuto in altri siti.